本文为节选内容

如需单份报告或打包(300多份人工智能报告,覆盖具身智能、工业机器人、人形机器人),联系客服购买

生成式人工智能(Generative Artificial Intelligence,简称GAI)1是基于算法、模型、规则生成文本、图片、声音、视频、代码等内容的人工智能技术分支。

早在二十世纪50 至90 年代,研究人员就已经开始利用算法来模拟人类进行创作,比如利用隐马尔可夫模型、高斯混合模型、贝叶斯网络来生成语音或时间序列数据。但这些尝试受到当时计算能力和数据资源的限制,成果较为有限。人工智能技术在内容创作方面的发展也因此遇到了瓶颈。

进入二十一世纪,深度学习的出现给人工智能的内容生成能力带来了革命性变化。2014年,生成对抗网络的概念被提出,成为人工智能技术发展的重要里程碑,并在图像生成等多个领域取得了显著成果,为日后生成式人工智能的出现打下基础。随后,变分自编码器和扩散生成模型等技术进一步推动了图像生成技术的发展。此外,随着长短期记忆网络和Transformer 等模型的出现,自然语言生成领域也取得了显著进展。

2022 年11 月,OpenAI 推出了ChatGPT 以及后续一系列模型,使得生成式人工智能开始拥有特定的产品形态,并引起了全世界的关注。这类产品不但能够与用户进行自然语言交流,还能生成高质量的文本、音频、视频内容,执行翻译、摘要和问答等复杂任务,展现了十分广阔的应用前景。此后,全球各行各业开始投入对生成式人工智能的研究和应用探索。

尤其在我国,百度、阿里巴巴、腾讯、华为等企业积极推动生成式人工智能技术的研发创新与应用落地,在经济发展、民生服务、科学发现等多个领域取得了积极成果。

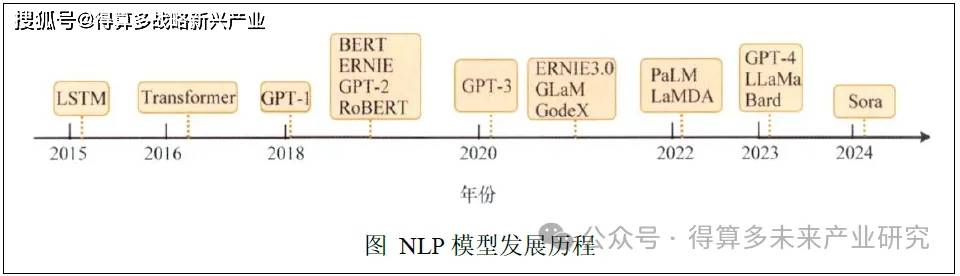

自然语言处理(NLP)模型发展历程

在AI 生成内容的早期,不同领域,如自然语言处理(natural language processing , NLP)和图像生成领域之间,没有太多的重叠。在NLP 领域,最初是使用N-gram 朴素语言模型,学习单词分布,通过前一个字符来预测下一个字符。因为该模型记忆能力有限,所以无法生成超过一定长度的连贯文本。相比之下,基于神经网络语言模型能够生成较长的连贯文本。用于建模语言的第1 类神经网络是循环神经网络(recurrent neural networks ,RNN),RNN 逐个阅读单词,同时更新思维状态,使得该模型具备短期记忆。由于RNN存在着短期依赖瓶颈问题,长短期记忆网络(long-short term memory , LSTM)被挖掘出来并用于长文本生成任务之中。在理论层面,LSTM 可以实现长时间记忆。然而,在具体的实践中,经过几十到100 个词后,该模型就开始偏离主题。为了解决这一问题,一种基于注意力机制的新型神经网络结构Transformer 在2017 年被提出,同时受到了广泛关注。该架构的并行化处理使其能够充分利用图形处理单元(graphics processing unit , GPU)。此外,该结构在设计层面上允许不断地堆叠编码器或解码器结构,使得整个网络结构能够变得更为复杂,这为后续大语言模型的出现奠定了基础。

自2018 年以来,基于Transformer 架构,大语言模型开始逐步涌现,其中最著名的当属Google 的来自Transformer 的双向编码器表示(bidirectional encoder representations fromtransformer , BERT)模型和OpenAI 的生成式预训练(generative pre-training , GPT)系列模型,其包括OpenAI 于2018 年率先提出的GPT-1 模型,约有1.2 亿个参数。紧接着Google于2019 年提出了BERT 模型,约有3.4 亿个参数,其整体性能优于GPT-1。随后,OpenAI迅速提出了GPT-2 模型,拥有的参数量高达15 亿,并在40 GB 的文本上进行了训练,实现了性能的进一步提升。之后,为实现更为优异的性能,OpenAI 于2020 年提出GPT-3模型,该模型具有1750 亿个参数,其性能足以碾压之前的GPT-1、BERT 和GPT-2 模型。然而,由于缺乏有效的引导,GPT-3 模型在生成文本内容时常常会出现一些不令人满意的结果。

为解决这一问题,OpenAI 提出了Instruct GPT 模型,具体通过人类反馈强化学习(reinforcement learning from human feedback , RLHF)机制引导模型生成符合预期的内容结果。基于Instruct GPT 模型,OpenAI 于2022 年推出了ChatGPT,带来了AIGC 面向大模型时代的浪潮。紧接着,OpenAI 在2023 年提出了GPT-4,其参数量高达到1.8 万亿,整体性能令人惊叹。这些模型擅长文本理解,在文本分类、实体检测和问题回答等能力上具有卓越的表现。同时,其他新兴的大模型如Sora,也为AIGC 领域带来了新的视角,Sora 模型通过其独特的架构和进阶的多模态处理能力,进一步拓宽了自然语言处理的应用范围。2024 年,一些新的突破性研究工作进一步推动了NLP 领域的发展。